设计未来城市,并使其能够生长,就要思考和理解城市。针对有关城市的大问题,我们访谈了许多处在前沿的思考者和实践者。

技术需要为人所用。城市科学治理,既需建立在掌握足够多的数据、充分了解情况的基础上,以更好地遵从相应的科学与专业规律,也要有前瞻性和引领性的思维,能够在关键的时刻,把事情拨入良性发展的轨道。前一点是人工智能机器擅长的;而要做到后一点,必须要靠人在不确定的情境中,去发挥自身的主动性。

该如何判断当下所处的局面?是顺从数据所示意的方向,还是依靠人发挥主动性去做出决策?不止城市系统会遇到这样的命题,人们在生活之中,都会面临这类重大时刻,可能更多要凭借某种自发的本能去决策。但城市系统的反应还是依赖既有的机制,因此需要在此之前做好准备。这或许也可视为应急工作的一部分。

关键时刻的决策

人和机器各有优势,反过来看,也各有局限。在陈楸帆看来,人的决策最根本的问题,还不在于无法获知全面信息,而是受到自身意识局限的牵制。面前可能有非常多条路,但我们只能看到非常有限的几条——有可能是利益权衡、政治冲突,或者是历史包袱,要想超越这些意识上的局限,是非常难的事情。

另一方面,机器决策与人工决策,在不同的场景,有完全不同的定义方式。陈楸帆举例说,比如极端情况之下,存在高度紧急、潜在后果非常严重、甚至会引发大规模战争的决策场景。此时人在其中的比重会更重。

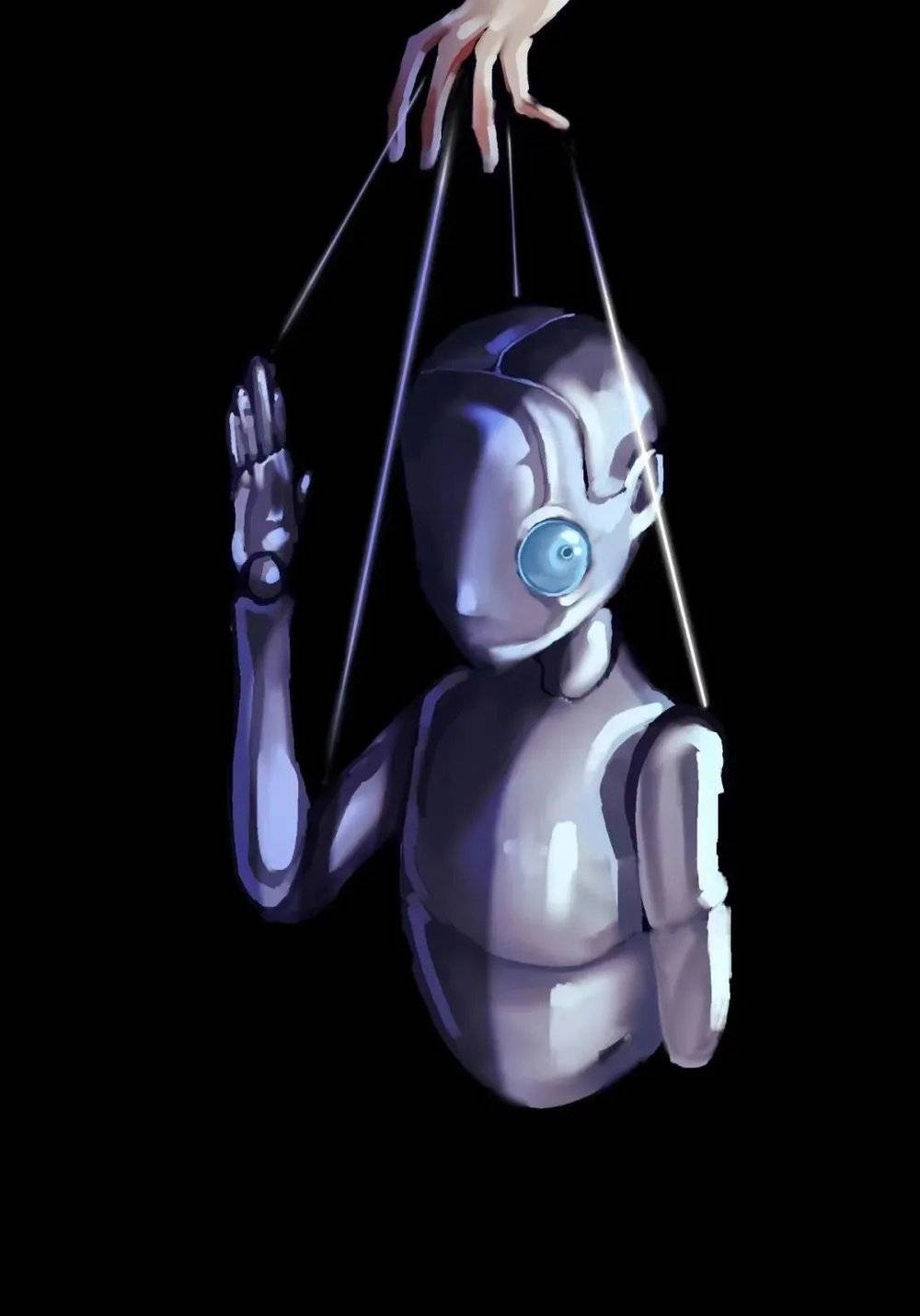

陈楸帆说到,一些国家的军事部门,对这类场景也有过诸多讨论。比如,无人机执行军事行动时,会用到诸多技术辅助,比如计算机视觉数据的匹配,来判断这是否需要打击的对象。但如果相应技术被用于大规模杀伤性武器,其误伤所造成的潜在风险,就变得非常大。相当于把很多人的生命,交在机器手上。因此,有一条“keep human in the loop”原则,即最后阶段决定是否执行攻击指令时,需要有人去做决策。

而相比之下,在没有那么紧急且重大的日常生活的场景里,人需要相对退到后面,机器要起到更大作用。因为,在对数据的阅读、对模式的识别等方面,机器更为擅长。这时,人的作用相当于把关程序正义。

但陈楸帆也意识到,在日常状态下,机器与人合作的决策过程中,也并非不存在值得担忧的部分。因为,系统并非处于静态,而是处在演进和反馈的过程中。也就是说,人也会被训练和改变。陈楸帆指出,在这样的系统里,执行了足够多的任务,人会倾向于变得更像机器——无论说被机器所驯化,还是说习惯于把更多决定交给机器。这又是一个反馈的回环。

或许,人不能永远做出正确的决策,但一直需要具备为自己负责的意识。陈楸帆说到,在这个意义上,我们又回到了非常朴素的、人道主义的观念上。这是一个非常大、但也非常小的意识:我们每一个人都有责任。

人的决策,能够包容偶然性

在科幻世界杂志社副总编拉兹的感受中,现在的城市生活,绝大部分时候都是在听机器的。比如当下的出行,大部分的人都完全跟着机器导航来走,这样的运行通常不会出什么问题。但他也指出,最敏感的事情,就是涉及大型的公共服务和每个人具体安全的方面,还需要逐步完善和联通。

在拉兹看来,人工智能必须在条件确定的场景中使用。一旦脱离这类场景,就无法使用。人们会制作一些应对不同场景的程序。而大量问题就产生在对接和关联的环节中。也就是说,需要兼容性时,人工智能的长处就不易发挥。拉兹举例说,就交通而言,一个专门针对红绿灯控制的人工智能,与另一个专门针对车道GPS定位的人工智能,相互的衔接和跨越会比较薄弱。这背后需要部门、人群之间的协同。

而在交通之外,城市还有很多更为复杂的场景,相应问题也更为艰巨。也就是说,对城市而言,需要让点状的人工智能可以更好地互动,把它们相互连接起来,才能更好地及时反映情况,支持更为科学和完善的决策。

但机器支持决策,不能也做不到穷尽城市所有面向。拉兹也说到,如果是机器决策,就会像一种完全不会犯错的DNA复制。对于生物体而言,DNA在复制过程中,需要有基因突变,才能成就物种的进步。这其中一定需要有出错。也许,从单个基因来看,这种突变毫无意义,但对整体的进化却有潜在的好处。只有这样,这个系统才有无尽的可能性。

城市生活也是相似的。拉兹说,人类本身就有追求满足好奇心的一面,会去做一些只是为了娱乐、好玩的事情,这些事情看似无意义,但对整体的进化却很有价值。

这些复杂的部分,是机器无法实现的。用清华大学建筑学院教授武廷海的话说,技术所创造的复杂性还是简单的复杂性,难以突破真正的复杂性。因此机器可以辅助人类,目前还不能支配人类。武廷海抱有谨慎乐观的态度,认为总体而言,技术带来的变化目前都是可以预期的。在他看来,新技术带来新思潮变化,也是创新的表现。一方面,“变则通,通则久”,变化是发展的常态。另一方面,“守中”也是一种高度理性,“中”代表了人,技术还是在为人服务。

回到技术的价值伦理

深圳大学建筑与城市规划学院研究员张宇星,也看到了这个面向。他指出,应思考如何化解技术被作为控制性工具的可能性。这是因为,现有的部分技术反而可能强化不公平。同时,掌握互联网工具的人拥有更强的控制权。这也是西方很多科技哲学家关注的问题。技术系统带来人类权利的平等,但系统的掌握者和其他人的不公平问题依然存在。这应当成为ICT反向考虑的原则性控制问题。另一方面,应从正向思考,如何让人们对资源能源的控制向更小更深尺度发展,缓解不平等现象。

清华大学建筑学院副教授周榕,则给我们更多警示。在宏观层面,他指出,不能否定技术,但技术必须经过人文的驯化,才能被更好地使用。当下,无所不在的焦虑、内卷、压迫,不知意义所在,没有价值感,都属于网络时代的症状,折射当下文明在转型过程中的结构性问题。事实上,技术进步或许会带来另一种文明。而新文明的建构不能由技术主宰,必须有人对此负责。这又需要回到价值伦理的层面去构建。

周榕说到,技术是组织文明的材料,当下会催生新的文明。而现有的意识形态主张,都是从旧文明里面出现的。因此,保持批判性思维可能更重要。

WeCityX团队总结

人工智能的高速发展,并在各个领域取代人类,常常令人担忧甚至心生恐惧。如何充分利用机器智能,而又充分发挥人的价值,在各种场景配合有度呢?

混合智能,或者说人机混合决策,可能是目前较为现实的方式。其两种表现形式是“基于认知计算的混合增强智能”和“人在回路的混合增强智能”。前者是指,在智能系统中引入各种受生物启发的计算智能技术,如模糊系统、神经网络系统、进化遗传算法等技术。而后者则将人的作用直接引入到智能系统中,形成人在回路乃至以人为中心的混合智能。前者善于在关键时刻快速决策;而后者,也许才是新的人类文明形态的最主要特征。

iNews新知科技 关注科技,自有新知

iNews新知科技 关注科技,自有新知